・パン・チルト・ズームカメラによる背景差分

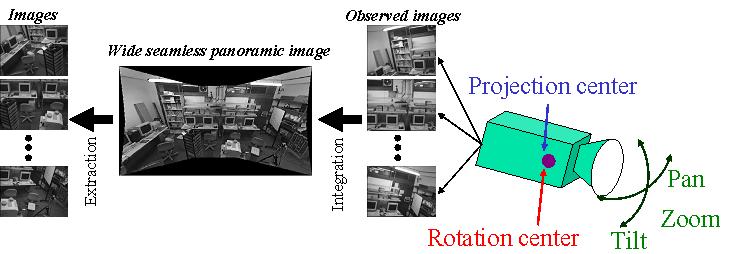

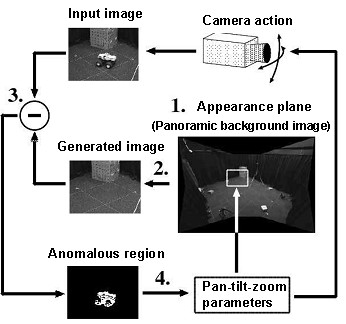

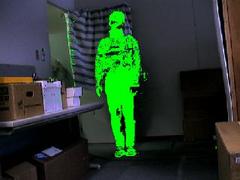

能動視覚システムにおいて,パン・チルト・ズームパラメータを変更しても見え方が変化しない能動画像観測法を提案する.この観測法は,能動カメラの投影中心と回転中心を一致させることにより実現できる.このように特殊なキャリブレーションを施されたカメラのことを視点固定型カメラと呼ぶ.このカメラを用いれば,パン・チルト・ズームを変更して撮影した画像を2次元的に変換することにより,静止シーンの見え方を一定に保つことが可能になる.よって,固定カメラを用いた場合と同様に能動視覚においても見え方の同一性に基づく処理処理(背景差分,テンプレートマッチング,フレーム間差分など)を正確に行うことができる. 視点固定型カメラによる撮影画像集合とそれらを変換・重畳して得られたパノラマ画像,およびこのパノラマ背景画像を利用した能動背景差分を図0に示す.

|

|

具体的に本研究では,以下の特徴を持つ背景差分と色検出の統合に着目した.

実験結果を図1,2,3,4に示す.

図1は実験環境を示す.

図2に示す入力画像からの対象領域検出を行った.

通常の背景差分による検出結果を図3に示す.照明の変化や背景物体(特にカーテン)の移動によってで誤検出が生じている.更にこれらの検出結果は,照明オンの背景画像と照明オンの入力画像との差分から検出結果を求めており,照明状況に応じた背景画像の適切な選択が行わなければ検出結果は更に悪化してしまう.

一方,図4に示す提案手法の検出結果では,照明変化や背景物体の移動に対してロバストに対象領域を正確に検出できていることが確認できる.また,提案手法における背景モデルは,一つの背景モデルが全ての照明状況における背景画像情報を含んでいるため,通常の背景差分にように背景画像の適切な選択処理が不必要であることも大きなメリットである.

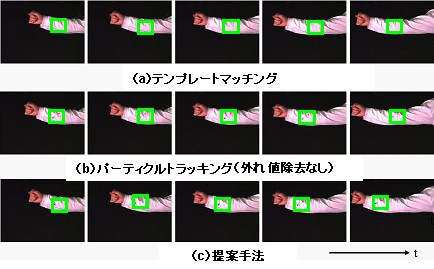

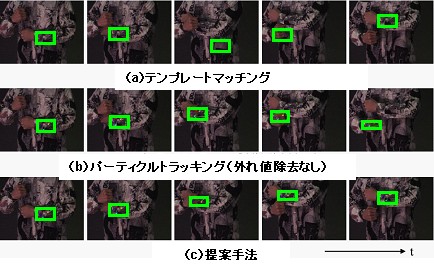

対象にズームアップした状態での追跡撮影により,移動対象のより高精細な画像を継続的に取得することができる.本研究では,画像中に大きく撮像された部分領域の追跡問題に焦点を当て,ズームアップした状態で画像中に大きく撮影された人物の部分領域(頭,前腕,手など)を追跡する手法を提案する.

従来の対象追跡手法は,対象領域全体を1つのモデルで表現している.しかし,対象領域全体を1つのモデルで表現すると,対象領域と同じテクスチャをもった近接領域との誤追跡を避けることは難しい.そこで本研究では,この近接類似領域(同じ着衣の前腕と上腕など)との誤追跡を避けるため,対象領域上に存在する特徴的な点の集合を追跡対象とみなし,対象領域を追跡する.このように特徴的な点のみに注目することで,領域全体の評価では目立たない近接類似領域との差異を得ることができる.本手法ではさらに,パーティクルフィルターを用いた確率的アプローチにより実現することで,追跡の安定性を確保する.さらに,ランダムサンプリングを用いたロバスト推定手法を用いた外れ点除去により,リアルタイム性を確保したまま,遮蔽に対応したロバストな追跡を実現している.

提案手法の有効性を示すために,人物の部分領域にズームアップした動画像を用いて追跡実験を行った結果を図5図6に示す.

広範囲における複数対象の実時間追跡を実現するために,我々は分散協調視覚の考えに基づいてシステムを設計している.分散協調視覚システムは,複数の能動視覚エージェントにより構成されており,能動視覚エージェント間の協調動作によりシステム全体として与えられたタスクを実現している.能動視覚エージェントとは,シーンの観測を行う観測ステーション(各種カメラパラメータを変更可能なアクティブカメラを備えた画像処理システム)の論理モデルである.

この追跡システムを実現するために,我々はまず(1)広範囲における対象検出及び追跡を行うためのアクティブカメラの設計(詳細はこちら),および(2)アクティブカメラを用いた実時間対象追跡法の提案(詳細はこちら),を行った.

このように首振りズームカメラを利用することにより,広範囲観測可能かつズーミングにより対象の詳細な画像も撮影可能な単一カメラによる継続的なターゲット注視が実現できた.

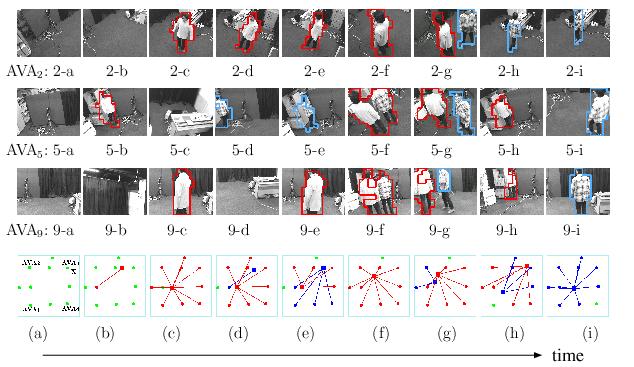

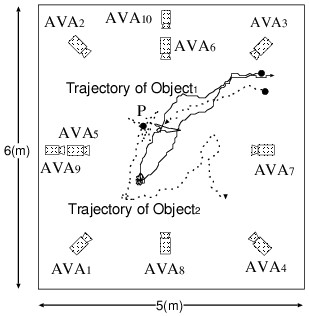

上記の単一カメラによる対象追跡によって能動視覚エージェントのターゲット注視機能が実現できる.次に,この能動視覚エージェントが複数存在するシステムにおける協調注視アーキテクチャについて研究を行った.提案システムでは,同一対象を注視するエージェント群がエージェンシを構成し,このエージェンシの内外で必要な観測対象情報を効率的かつ実時間で交換することにより,システム全体として複雑な動的状況下における複数の移動対象の実時間追跡を可能としている(詳細はこちら).実験における観測対象画像集合を図7に,推定された各対象の移動軌跡を図8に示す.

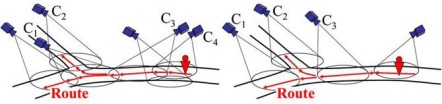

複数カメラ画像の共有視野で同時観測される対象の追跡を行う際,カメラ群の3次元位置・姿勢が既知であれば,検出対象の3次元位置情報の整合性を利用すると対象同定が容易となる.上述の複数アクティブカメラによる対象群追跡でも,この空間的整合性を利用した対象同定を行っている.この空間的整合性を利用した対象同定は,図9(左)のように全ての視野が他のいずれかの視野と重なりがあることを仮定している.ゆえに,さらに広域(ビル全体,屋外交通網など)における移動物体の活動状況の調査などに利用するためには,全対象経路を網羅したカメラ配置が必要になる.こうした全網羅的なカメラ配置はコスト・管理の両面から実質的に困難である.

そこで,図9(右)に示すような視野に重なりの無い分散カメラ群による広域追跡が必要になる.こうした不可視領域を含んだ対象追跡における複数カメラ間での対象同定は,前述の視野の重なり領域における対象同定と比較して非常に困難な問題である.この問題に対しては,画像情報による同定に加えて,視野間の確率的な連結関係を参照して同定精度を上げるアプローチが有効である.そこで本研究では,こうした視野間の確率的な連結関係を観測画像集合から自動的に推定する手法を提案した.

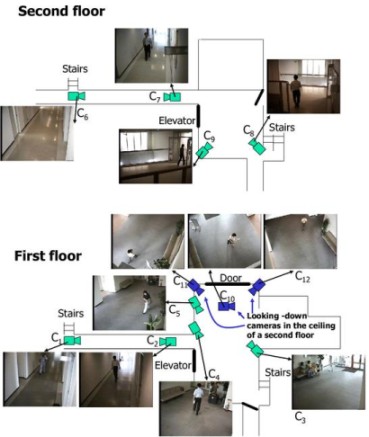

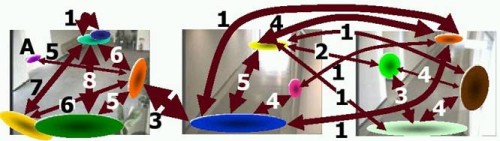

12台のカメラを図10のように分散配置した屋内環境下で実験を行った.この入出情報から,114(57の双方向経路)の経路が検出された.検出経路の例を図11に示す.楕円と矢印がそれぞれ始点や終点の位置・分散と始点終点の対応付けを表し,矢印上の数字が経路間の平均経過時間を示す.

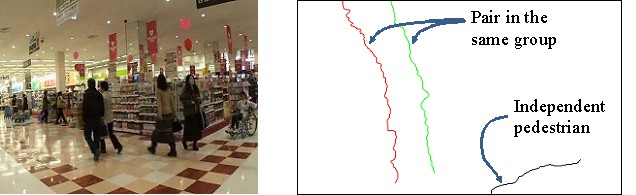

This paper proposes a method for detecting people groups from their

trajectory data. This grouping is applied to each pair of people. The

trajectories of the pair are featured by their spatio-temporal

relationships such as a distance and velocities. The features are

classified to either of ``group'' or ``non-group'' by a discriminative

classifier. In contrast to previous features, the proposed features

are robust to unsteady behaviors of people and noise of their

trajectories. Experimental results using a publicly-available dataset

of trajectories demonstrate the effectiveness of the proposed

method. 図12

本研究では,視野に重畳のない分散カメラ群によって,広域を移動する人をそれぞれ追跡するために,新たに各人のグループ特徴量を利用する追跡法を提案する.本手法では,カメラ間の移動においてグループ(行動を共にする1人以上の人の集まり)の関係は変化しないという仮説の下,その人が属しているグループに関する特徴量をカメラ間人同定に用いるために,まず各カメラにおける追跡結果から,人のグループ検出を行う.そして,グループ検出の結果からグループ特徴量を算出し,色情報やカメラ間の移動時間を反映させた既存の特徴量と併用することによって,カメラ間で人を同定する.実験では,まず軌跡同士の関係からグループ検出が平均83%の精度で行えることを確認した.また,グループ検出結果から得たグループ特徴量によってカメラ間人同定の精度が37%増すことを確認した(同定成功結果図13).

広域にわたる交通流量解析やセキュリティのための監視システムなどへの応用を目的として,長時間動画における複数対象追跡を実現する.大域的最適解を得る複数対象追跡では,各検出結果をノードに対応付けたグラフにおける最小コスト経路探索が行われる.従来法では,グラフの構造上,隣接2フレーム間でそれぞれの静的特徴量(位置・サイズなど)を抽出し,それらの差分から計算できるコストのみが探索に利用できた.提案法では,進行方向のような動的特徴量の差分をコストに利用するため,各ノードが追跡経路に応じて複数の動的特徴量を持つ場合,そのノードを仮想的に分割する.各分割ノードが異なる進行方向を経由した追跡経路に対応つき,生成されたグラフに対して従来法とおりの解探索法によって大域的最適解を得ることができる.実験では,Person Re-ID2011 datasetを使い,従来法と比較して,提案法により追跡成功率が向上していることを定量的に確認する.また,提案法の効果の典型的な例を画像で示し,目標としていたすれ違い時の追跡成功を実現できていることを確認する(図14).

・背景変動にロバストな対象領域検出

観測画像中から背景外物体や移動物体を興味領域(画像理解・認識の処理対象となる領域)として検出する手法は,数多くの視覚システムの最も基盤となる技術の一つであり,様々な手法が提案されている.

中でも背景差分は,ターゲットに関する事前知識を必要とせず任意の対象を検出可能であり,本質的に静止領域の検出が不可能なフレーム間差分や事前に定義されたターゲットしか検出できない顔検出・肌色検出と比較して,多くの視覚システムで利用されている.特に,十分な背景情報を事前に学習可能な環境下であれば優れた結果を期待できる.

そこで本研究では,背景差分をベースとし,対象領域の切り出しを必要とするあらゆる視覚システムの基盤技術として利用可能な対象検出法の実現を目的とする.

よって,両手法の長所・短所は相補的であり,両手法を有機的に統合することにより,背景変動(例えば,照明の変化,木の葉やカーテンなどの揺れなど)に対してロバスト,かつ背景と任意の対象の微妙な色の差も検出可能となった.

・特徴点群追跡によるズームアップパーツの追跡

・複数アクティブカメラによる対象群追跡

上段:各カメラによる観測画像(各検出領域を異なる色の枠で囲んでいる),

下段:各瞬間における各カメラとその注視対象の対応関係

(観測シーンの鳥瞰図:カメラ位置を○,対象位置を□,それらの対応関係を線で示す)